By Henk van Houten

Executive Vice President, Chief Technology Officer, Royal Philips

Titulares como "La IA vence a los médicos" o "La IA supera a los radiólogos" están cautivando al público, presumiendo de las impresionantes capacidades de los algoritmos de IA en tareas que pueden salvar vidas, como detectar el cáncer de mama o predecir enfermedades cardíacas. Si bien estos titulares revelan cuánto progreso se ha logrado con la inteligencia artificial, en cierto modo también son engañosos, porque sugieren una falsa dicotomía. Es cierto que un algoritmo de IA debe funcionar a la par o incluso mejor que un experto humano en una tarea específica para que sea valioso en la atención médica. Pero en realidad no se trata de que uno "gane" al otro. Muchas de las decisiones que los médicos toman a diario son increíblemente complejas y, como argumentaré, requieren más que un enfoque basado en datos o IA. Tanto los médicos como la IA tienen sus fortalezas y limitaciones únicas. Es su inteligencia conjunta lo que cuenta si queremos marcar una diferencia significativa en la atención al paciente. Este es el por qué.

La promesa de la IA: un par adicional de ojos sobrehumanos

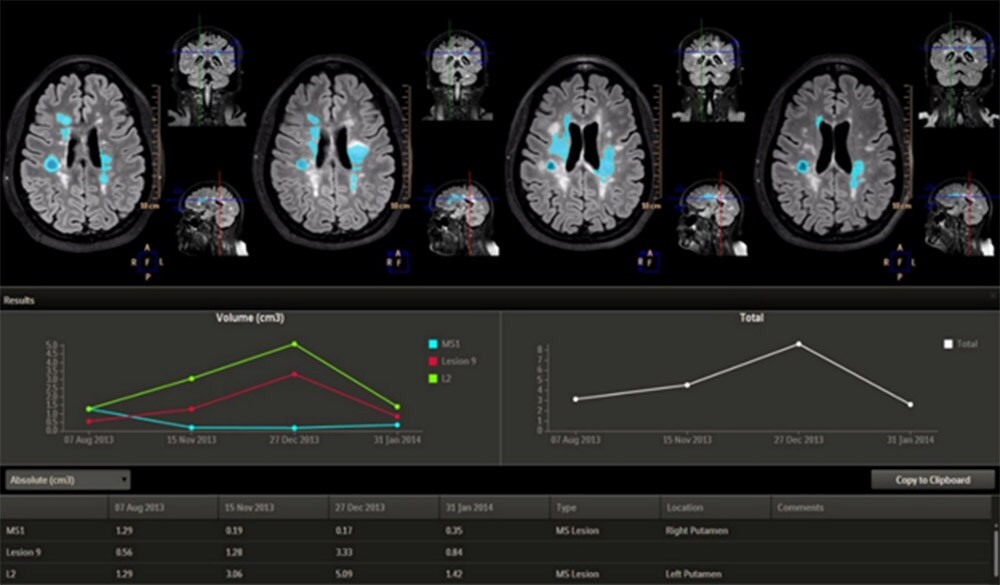

Lo que a veces se pasa por alto en el discurso popular es que la IA, como se define aquí, ya ha estado con nosotros durante décadas. Irónicamente, los primeros sistemas de IA se basaban en gran medida en el conocimiento de los expertos, que era codificado en el software de un ordenador. Sin embargo, en los últimos años, un enfoque de la IA basado en datos ha tenido prioridad, gracias a la explosión de datos digitales que ha impulsado el desarrollo del deep learning, que también es el tema central de este artículo. Los algoritmos de deep learning aprenden de grandes cantidades de datos anotados, a menudo con una precisión superior, pero sin estar preprogramados explícitamente [1]. La principal fortaleza del deep learning es que puede detectar, cuantificar y clasificar incluso los patrones más sutiles en los datos, lo que ofrece un conjunto adicional de ojos "sobrehumanos". Esto hace que los algoritmos de deep learning sean ideales para respaldar disciplinas médicas centradas en patrones como la radiología y la patología, que enfrentan cargas de trabajo cada vez mayores junto con una escasez severa y creciente de profesionales en muchas partes del mundo [2]. Los ejemplos son tan variados como prometedores. Los algoritmos de deep learning pueden aliviar a los profesionales de tareas repetitivas y laboriosas como segmentar las lesiones pulmonares en las tomografías computarizadas [3], rastrear cómo se desarrollan los tumores cerebrales a lo largo del tiempo en las resonancias magnéticas para ayudar a monitorear la progresión de la enfermedad [4], o clasificar la gravedad del cáncer de próstata según las muestras de tejido [5].

Para desentrañar la naturaleza complementaria de la inteligencia artificial y la experiencia humana en la atención médica, comencemos con una breve introducción a la inteligencia artificial y su modelo más moderno: el deep learning.

Aquí es donde los beneficios de la IA se destacan claramente. Al automatizar las tareas de menor capacitación, la IA puede liberar tiempo para que los médicos se concentren en tareas de mayor capacitación que agregan valor y en la interacción del paciente. Pero cuando se trata de la toma de decisiones diagnósticas, lo que está en juego aumenta y el panorama se vuelve más complejo.

Dos pares de ojos ven más de uno: la necesidad de supervisión humana

Sabemos que incluso los médicos más experimentados pueden pasar por alto algunas cosas. Todavía se producen diagnósticos perdidos o erróneos. De hecho, un estudio realizado por la National Academy of Sciences en 2015 mostró que la mayoría de las personas experimentarán al menos un error de diagnóstico en su vida [6]. Sin embargo, la verdad es que los algoritmos de IA tampoco serán infalibles. Ellos también pueden equivocarse. Incluso si es solo en 1 de cada 100 casos. Claramente, ese es un riesgo que debemos mitigar cuando se usa un algoritmo para evaluar si es probable que un paciente tenga un tumor maligno o no.

Es por eso que la supervisión humana es esencial, incluso cuando un algoritmo es muy preciso. La aplicación de dos pares de ojos a la misma imagen (un par humano, un par de IA) puede crear una red de seguridad, y el médico y la IA compensan lo que el otro puede pasar por alto.

Un estudio reciente publicado en Nature muestra cómo una asociación entre humanos e IA podría funcionar en la detección del cáncer de mama [7].

El cáncer de mama es la segunda causa principal de muerte por cáncer en las mujeres. Afortunadamente, la detección y el tratamiento tempranos pueden mejorar considerablemente los resultados. Sin embargo, la interpretación de las mamografías sigue siendo un desafío, ya que los expertos humanos logran distintos niveles de precisión. Por lo tanto, hacer que dos radiólogos lean la misma mamografía ha sido una práctica establecida desde hace mucho tiempo en el Reino Unido y muchos países europeos, lo que produce un resultado superior en comparación con el paradigma de un solo lector. Sin embargo, este paradigma de doble lectura también ha sido discutido, y algunos argumentan que consume una cantidad prohibitiva de recursos, ya escasos. ¿Qué pasaría si, en lugar de depender de dos expertos humanos, reemplazáramos uno con IA mientras seguimos manteniendo al otro experto al tanto de la supervisión humana? Según los hallazgos publicados en Nature, esto no conduciría a un resultado peor en comparación con el paradigma tradicional de doble lectura con dos lectores humanos. Eso significa que la carga de trabajo del radiólogo podría reducirse considerablemente con el apoyo de la IA, al tiempo que se conserva el juicio de los expertos como parte del proceso para detectar cánceres que el algoritmo pueda haber pasado por alto. Es un ejemplo convincente del poder de la asociación entre humanos e inteligencia artificial. Y hay otros modelos colaborativos que también se basan en el mismo principio de los cuatro ojos. La IA puede actuar como un primer lector, un segundo lector o como una herramienta de clasificación que ayuda a priorizar las listas de trabajo en función de la sospecha de los hallazgos [8]. Sin embargo, para comprender realmente por qué no podemos confiar únicamente en los algoritmos cuando se trata de la toma de decisiones clínicas, debemos investigar aún más y examinar dónde pueden fallar.

El deep learning no es un profundo conocimiento

Como se explicó anteriormente, los algoritmos de deep learning pueden descubrir incluso los patrones más sutiles en los datos, sin obstáculos por las limitaciones humanas en la agudeza perceptiva o las limitaciones del conocimiento previo. Eso es lo que los hace tan valiosos, permitiéndonos ver más de lo que podríamos ver con nuestros propios ojos. Pero hay otra cara en esa moneda. Por más precisos que sean los algoritmos de aprendizaje profundo para realizar una tarea claramente definida, como la detección de tumores de mama de cierto tamaño o forma, no desarrollan una verdadera comprensión del mundo. No tienen la capacidad de razonar o abstraer más allá de los datos en los que fueron entrenados. Solo son inteligentes en un sentido estricto. Y eso significa que debemos utilizarlos con cuidado.

Un ejemplo de advertencia sobre esto es un estudio sobre el reconocimiento visual de las señales de tráfico. Un algoritmo fue entrenado para reconocer las señales de STOP en un laboratorio, y lo hizo admirablemente bien, hasta que encontró señales de STOP que estaban parcialmente cubiertas con grafitis o pegatinas. De repente, se podía engañar al algoritmo, que de otro modo sería preciso, para clasificar erróneamente la imagen, confundiéndola con un letrero de límite de velocidad a 45 en el 67% de los casos cuando estaba cubierto por un graffiti, e incluso en el 100% de los casos cuando estaba cubierto con pegatinas [ 9].

Usted o yo nunca confundiríamos una señal de STOP y una señal de límite de velocidad. Eso es porque, como personas, tenemos una sólida comprensión conceptual de ambos, basada en características definitorias como su forma y color. Pero el algoritmo "vio" solo patrones de píxeles, lo que le hizo fallar ante las desviaciones de los datos en los que fue entrenado. Por supuesto, estos intentos deliberados de engañar a un algoritmo pueden no ser motivo de preocupación para las aplicaciones médicas siempre que los datos estén debidamente protegidos. Sin embargo, lo que este ejemplo destaca es cómo una dependencia pura en el reconocimiento de patrones puede desviar a los algoritmos cuando encuentran datos desconocidos.

¿Un algoritmo que funciona bien en un hospital será tan preciso en otro hospital? ¿Se generalizará bien de una población a otra? Estas son preguntas críticas que requieren el juicio y la validación de expertos. Una vez más, se demuestra por qué la IA y el deep learning deben ir de la mano, incluso antes de que un algoritmo se use en la práctica clínica.

Con la supervisión humana adecuada y una comprensión adecuada de las fortalezas y limitaciones de un algoritmo, se puede usar de una manera eficaz, segura y justa. Pero hay una advertencia más.

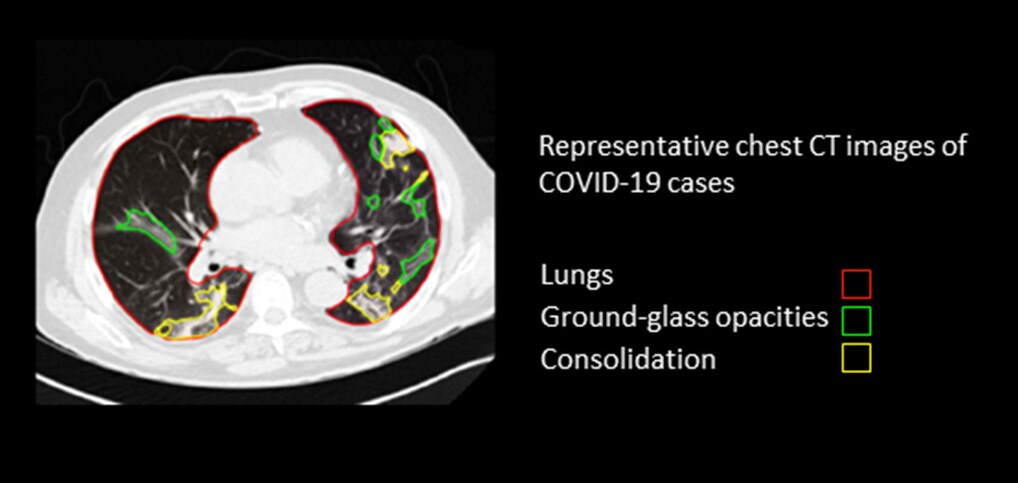

La medicina es más que un reconocimiento de patrones

Hemos visto cómo el reconocimiento de patrones se presta bien a la optimización algorítmica, siempre que se establezcan las medidas de seguridad adecuadas. Los médicos, sin embargo, tienen una tarea mucho más amplia que va más allá del mero reconocimiento de patrones. Tome una tomografía computarizada de los pulmones como ejemplo. Los algoritmos pueden ayudar a detectar y segmentar áreas de los pulmones que muestran una mayor densidad, como las denominadas opacidades o consolidaciones en vidrio esmerilado. Sin embargo, estas anomalías pueden indicar una amplia gama de afecciones médicas. Podrían ser el resultado de una infección viral (posiblemente, pero no necesariamente COVID-19), una enfermedad no infecciosa o una contusión pulmonar, por nombrar solo algunas posibilidades. Para averiguar qué le ocurre al paciente, el radiólogo o el médico evaluará también otros tipos de datos (que no son de imágenes) y los conectará con el historial del paciente, los síntomas actuales y las posibles comorbilidades.

Es este tipo de interpretación holística donde realmente entra en juego la comprensión contextual del médico. Decidir sobre el diagnóstico y el tratamiento requiere una sensibilidad hacia el paciente como un ser humano único; la capacidad de mirar más allá de los patrones de píxeles y ver a la persona completa en contexto. Es un proceso que es muy difícil de emular algorítmicamente. El deep learning se basa en grandes conjuntos de datos estructurados. Pero cuando se trata de un diagnóstico médico complejo que implica muchos factores diferentes, el número de pacientes para los que se dispone del conjunto completo de datos suele ser demasiado limitado para construir un algoritmo predictivo suficientemente fiable [10]. Por supuesto, a medida que la tecnología evolucione y logremos abordar con éxito algunos de los desafíos de datos en la atención médica, la capacidad de la IA para realizar predicciones significativas a partir de datos complejos y multimodales seguirá creciendo. Sin embargo, es posible que no siempre haya ejemplos de algoritmos de deep learning en los que basarse. Un paciente puede presentar una combinación única de síntomas. Un medicamento nuevo puede tener efectos secundarios imprevistos. Tales variaciones novedosas ocurren todo el tiempo en la práctica clínica; desafiando lo que puede derivarse algorítmicamente de datos históricos. O, como dice el pionero de la inteligencia artificial Gary Marcus: "En un mundo verdaderamente abierto, nunca habrá suficientes datos [1]". Esto plantea preguntas aún más fundamentales sobre la naturaleza complementaria de la IA y la experiencia humana, y el futuro de la innovación en IA que nos proponemos. En nuestro entusiasmo sobre las posibilidades del deep learning, ¿nos hemos centrado demasiado unilateralmente en el big data como combustible de toda la innovación en IA? ¿Qué pasa con el conocimiento clínico y científico que ya hemos adquirido a lo largo de los siglos? ¿Podemos encontrar formas nuevas y creativas de unir lo mejor de ambos mundos? Estas son preguntas que exploraré con más detalle en un artículo futuro, y también agradezco mucho sus opiniones, porque realmente creo que nunca hay un solo enfoque que haga que todos los demás sean inútiles u obsoletos. La medicina es compleja. La inteligencia es polifacética. Solo reconociendo esta complejidad podemos impulsar la atención médica de manera significativa, combinando lo mejor de lo que los expertos humanos y la inteligencia artificial tienen para ofrecer, de manera conjunta, una mejor atención al paciente.

Referencias [1] Marcus, G., Davis, E. (2019). Rebooting AI: building artificial intelligence we can trust. [2] Topol, E. (2019). Deep medicine: how artificial intelligence can make healthcare human again. [3] Aresta, G., Jacobs, C., Araújo, T. et al. (2019). iW-Net: an automatic and minimalistic interactive lung nodule segmentation deep network. Sci Rep 9, 11591. https://www.nature.com/articles/s41598-019-48004-8 [4] https://www.fiercebiotech.com/medtech/philips-gets-fda-nod-for-radiology-informatics-platform [5] Nagpal, K., Foote, D., Liu, Y. (2019). Development and validation of a deep learning algorithm for improving Gleason scoring of prostate cancer. npj Digit Med 2:48 https://www.nature.com/articles/s41746-019-0112-2 [6] The National Academies of Science Engineering Medicine (2015). Improving diagnosis in health care.https://www.ncbi.nlm.nih.gov/books/NBK338596/ [7] McKinney, S.M., Sieniek, M., Godbole, V. et al. (2020) International evaluation of an AI system for breast cancer screening. Nature 577, 89–94 https://pubmed.ncbi.nlm.nih.gov/31894144/ [8] Obuchowski, N.A., Bullen, J.A. (2019). Statistical considerations for testing an AI algorithm used for prescreening lung CT images. Contemporary Clinical Trials Communications 16:100434https://www.sciencedirect.com/science/article/pii/S2451865419301966 [9] Eykholt, K., Evtimov, I., Fernandes, E., et al. (2018) Robust physical-world attacks on deep learning models.arXiv preprint arXiv:1707.08945 https://arxiv.org/abs/1707.08945 [10] Van Hartskamp, M., Consoli, S., Verhaegh, W., Petkovic, M., Van de Stolpe, A. (2019). Artificial Intelligence in clinical healthcare applications: viewpoint. Interact J Med Res, 8(2): e12100.https://pubmed.ncbi.nlm.nih.gov/30950806/

Sobre Royal Philips

Royal Philips (NYSE: PHG, AEX: PHI) es una empresa líder en tecnologías de la salud, centrada en mejorar la salud y el bienestar de las personas, y facilitar la obtención de mejores resultados en el ciclo de la salud, desde los hábitos saludables y la prevención, hasta el diagnóstico, tratamiento y cuidado en el hogar. Philips hace uso de su avanzada tecnología y de sus profundos conocimientos clínicos y del consumidor para ofrecer soluciones integradas. Con sede en los Países Bajos, la compañía es líder en diagnóstico por imagen, terapia guiada por imagen, monitorización de pacientes e informática de la salud, así como en salud del consumidor y atención domiciliaria. Philips ha registrado unas ventas de 19.500 millones de euros en 2020 y emplea aproximadamente a 82.000 empleados, con operaciones comerciales y servicios en más de 100 países. Todas las noticias sobre Philips se encuentran en nuestro Centro de noticias

Share on social media

Topics

Author

Henk van Houten

Former Chief Technology Officer at Royal Philips from 2016 to 2022